Llama 3是一款由Meta推出的新一代开源人工智能大语言模型,Llama-3 包含 8B(80亿参数)、70B(700亿参数)两个版本,分为基础预训练和指令微调两种模型,还有一个超4000亿参数正在训练中。

与Llama-2相比,Llama-3使用了15T tokens的训练数据,在推理、数学、代码生成、指令跟踪等能力获得大幅度提升。

此外,Llama-3还使用了分组查询注意力、掩码等创新技术,帮助开发者以最低的能耗获取绝佳的性能。很快,Meta就会发布Llama-3的论文。

Llama 3的亮点特性

Llama 3的亮点特性

- 模型架构:Llama 3采用了高效的Transformer架构,具有128K token的分词器,以及分组查询注意力(Grouped Query Attention)技术,提升了模型在处理长序列时的效率。

- 大规模预训练:Llama 3基于超过15万亿tokens进行预训练,数据集规模是前代Llama 2的七倍,代码数据量增加了四倍。

- 多语言支持:预训练数据中超过5%是非英语的高质量数据,覆盖超过30种语言,尽管主要性能仍以英语为主。

- 错误减少:Llama 3设计上减少了错误拒绝的情况,即模型能够更准确地判断无害的提示并给出回应。

- 指令微调:Llama 3在后训练阶段采用了多种技术,包括监督式微调、拒绝抽样、近端策略优化和直接策略优化,以提升模型在特定任务上的表现。

Llama 3 的测试结果

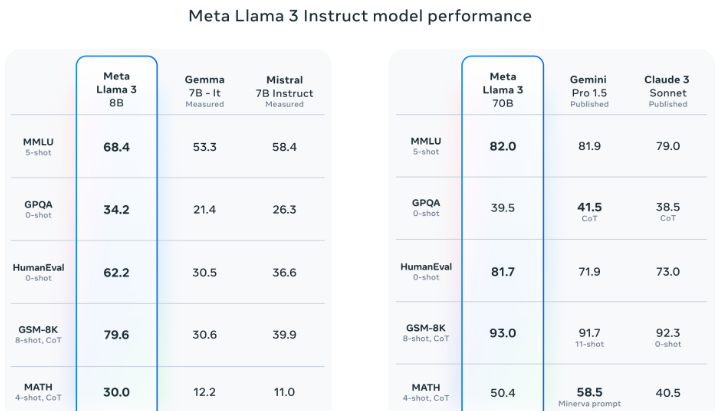

Meta声称Llama 3在关键基准测试中优于同类竞争模型,尤其是在编程等任务上。此外,通过“大海捞针”测试,即在长文本中识别并准确回答一个无关句子的能力,Llama 3展现了其卓越的性能。

在MMLU、HumanEval和GSM-8K上,Llama 3 70B击败了Gemini 1.5 Pro。尽管无法与Anthropic性能最强的模型 Claude 3 Opus媲美,但 Llama 3 70B的性能,已经优于Claude 3系列的中杯模型Sonnet。

在MMLU、HumanEval和GSM-8K上,Llama 3 70B击败了Gemini 1.5 Pro。尽管无法与Anthropic性能最强的模型 Claude 3 Opus媲美,但 Llama 3 70B的性能,已经优于Claude 3系列的中杯模型Sonnet。

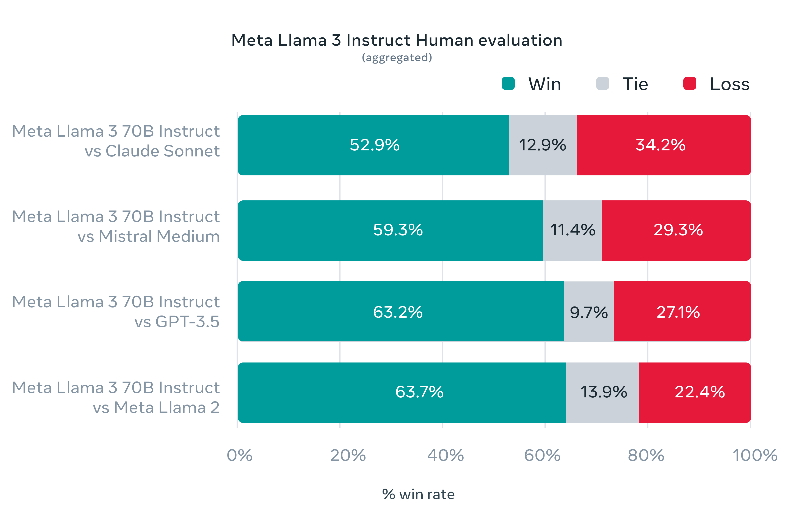

在Meta组织的人类反馈评分中,Llama 3 70B打败了Mistral、OpenAI、Claude发布的对应产品。

在Meta组织的人类反馈评分中,Llama 3 70B打败了Mistral、OpenAI、Claude发布的对应产品。

这个人类反馈测试更贴近用户实际的使用体验,包括了最常见的大模型使用场景:头脑风暴、创意写作、角色扮演、复述、推理、总结等。

如何使用Llama 3?

如何使用Llama 3?

开发人员:

Llama 3模型已经在 Hugging Face、GitHub 和Replicate上开源,下面是入口:

- Llama 3官网链接:https://llama.meta.com/llama3

- 模型下载链接:https://llama.meta.com/llama-downloads/

- Hugging Face链接:https://huggingface.co/meta-llama

- Replicate链接:https://replicate.com/meta

- GitHub项目地址:https://github.com/meta-llama/llama3

另外,Llama 3模型将很快在AWS,Databricks,Google Cloud,Hugging Face,Kaggle,IBM WatsonX,Microsoft Azure,NVIDIA NIM和Snowflake上提供,并获得AMD,AWS,戴尔,英特尔,NVIDIA和高通提供的硬件平台的支持。

普通用户:

对于不懂技术的普通用户,可以通过下面网址体验:

- Meta AI官网:通过Meta.ai体验Llama 3模型。(限制了国家和地区,可能会打不开)如果打不开,可使用下面??网址。

- Huggingface:https://huggingface.co/chat/,模型里切换到Llama 3即可体验。

- Replicate:https://llama3.replicate.dev/

- 英伟达:https://www.nvidia.com/en-us/ai/#referrer=ai-subdomain

- 集成到社交平台:Llama 3作为Meta AI助手的底层模型,你也可以在Facebook、Instagram等Meta的应用程序中直接与之交互。

总之,Llama 3的发布标志着Meta在AI领域的重大进展,展示了其在创建高性能、多用途语言模型方面的能力。随着模型的进一步迭代和优化,预计Llama 3将在AI助手和语言技术领域扮演越来越重要的角色。