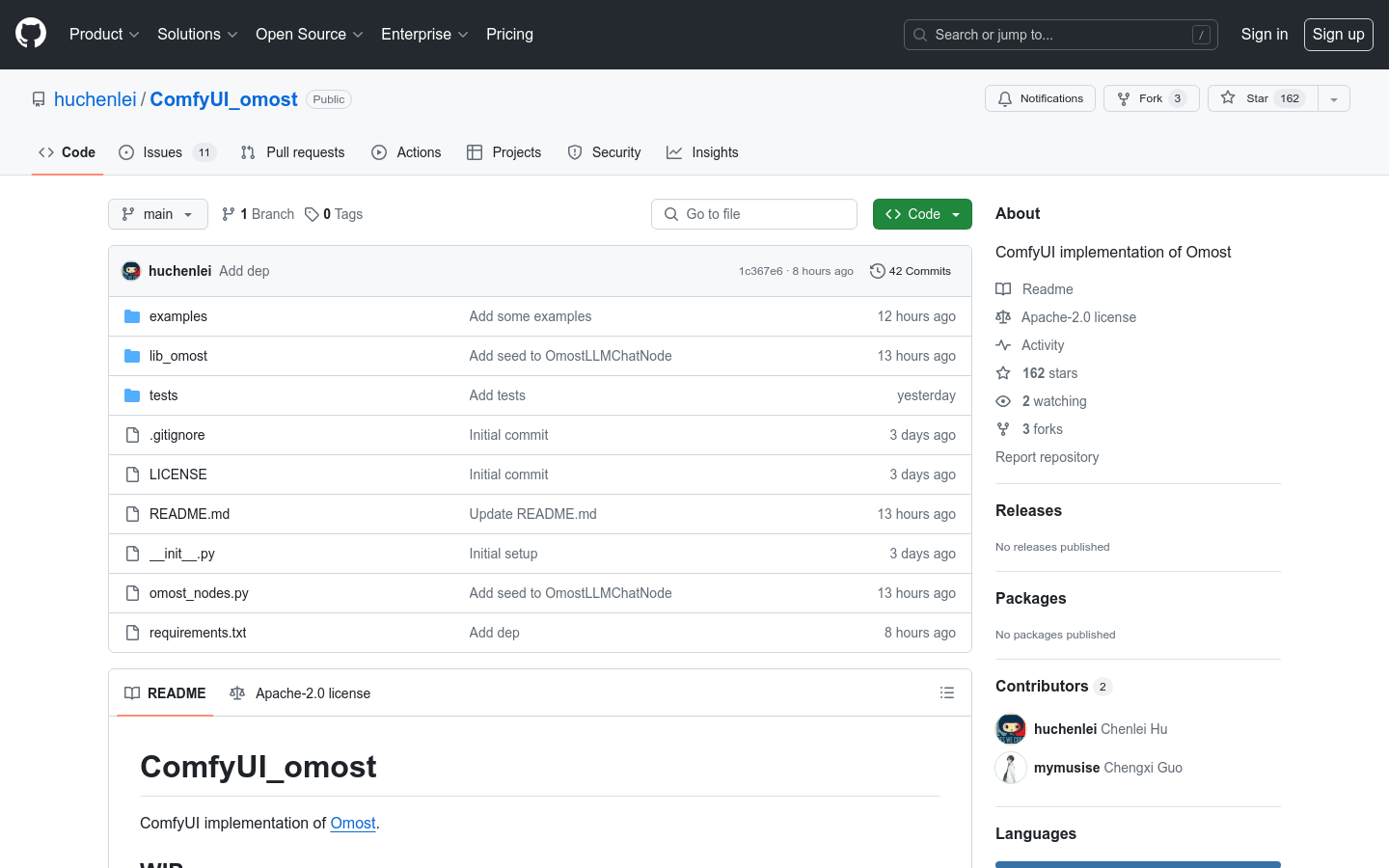

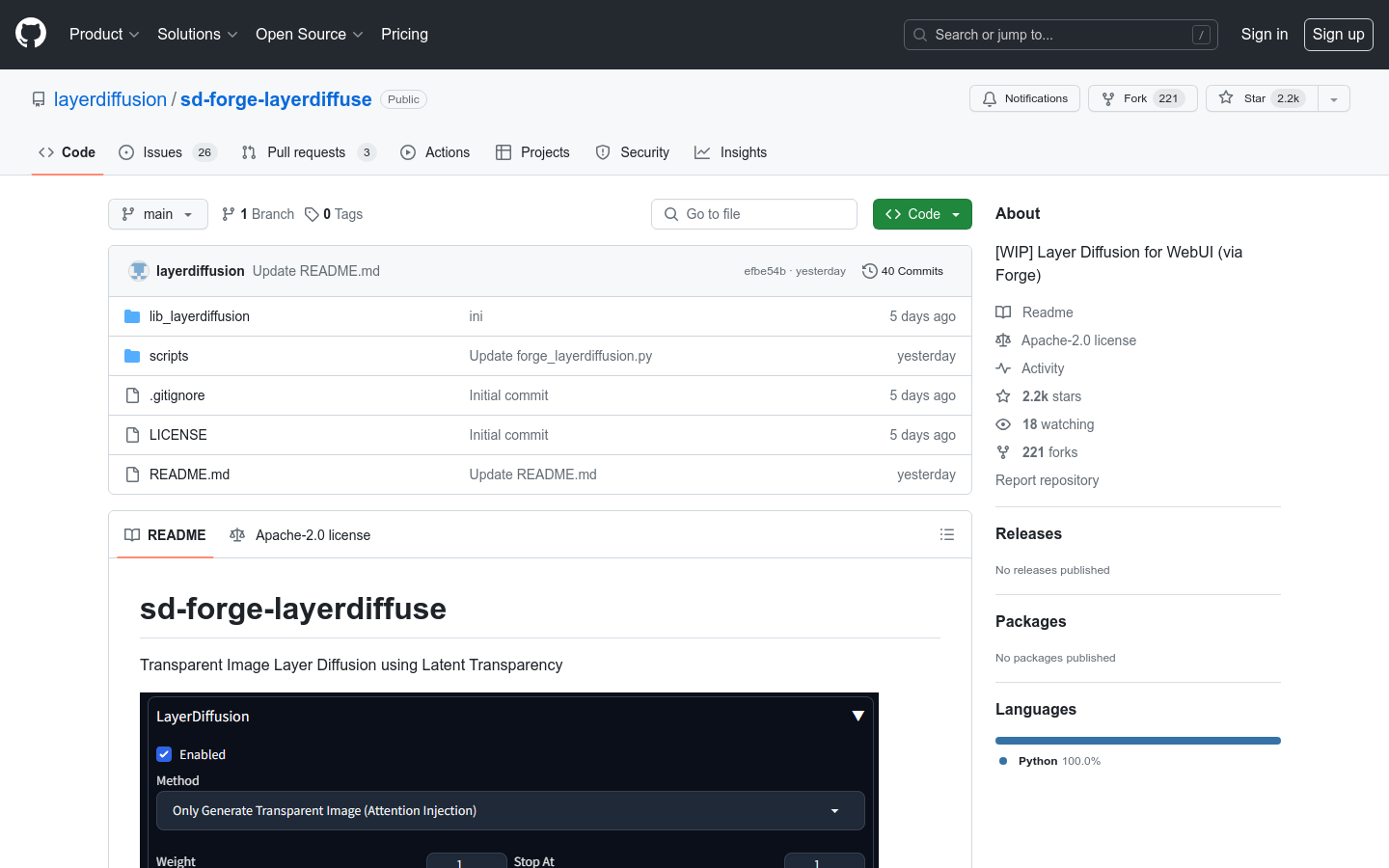

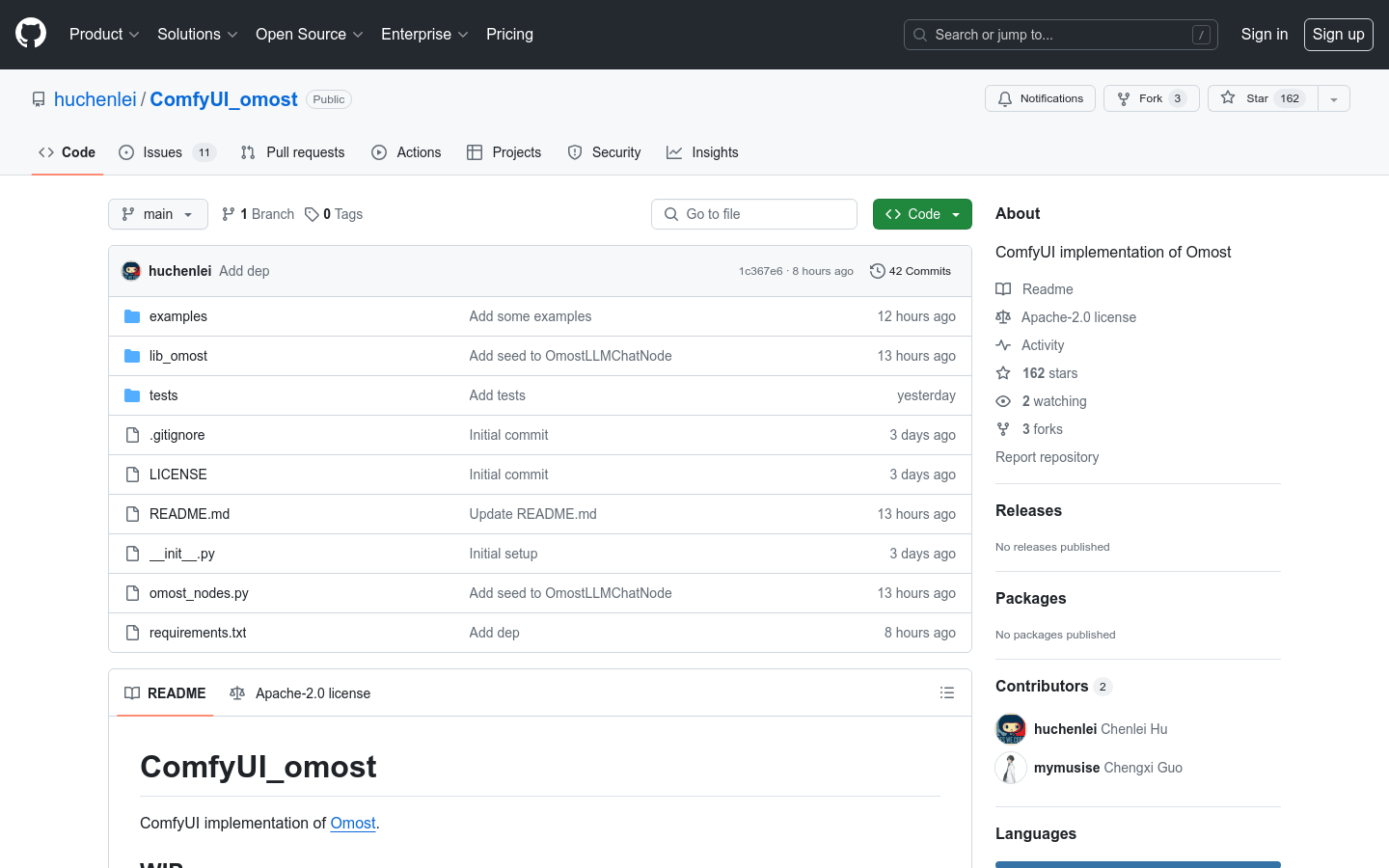

ComfyUI_omost

ComfyUI_omost是一个基于ComfyUI框架实现的Omost模型,它允许用户与大型语言模型(LLM)进行交互,以获取类似JSON的结构化布局提示。该模型目前处于开发阶段,其节点结构可能会有变化。它通过LLM Chat和Region Condition两个部分,将JSON条件转换为ComfyUI的区域格式,用于图像生成和编辑。

需求人群:

“目标受众为图像生成和编辑领域的开发者和研究人员,他们可以利用ComfyUI_omost模型快速生成和编辑高质量的图像。此模型特别适合需要进行复杂图像布局设计的用户,因为它提供了结构化的JSON布局提示,使得图像生成过程更加可控和精确。”

使用场景示例:

使用LLM Chat进行简单的图像生成。

通过多轮LLM Chat生成具有复杂布局的图像。

结合ControlNet/IPAdapter对特定区域进行控制,生成具有特定特征的图像。

产品特色:

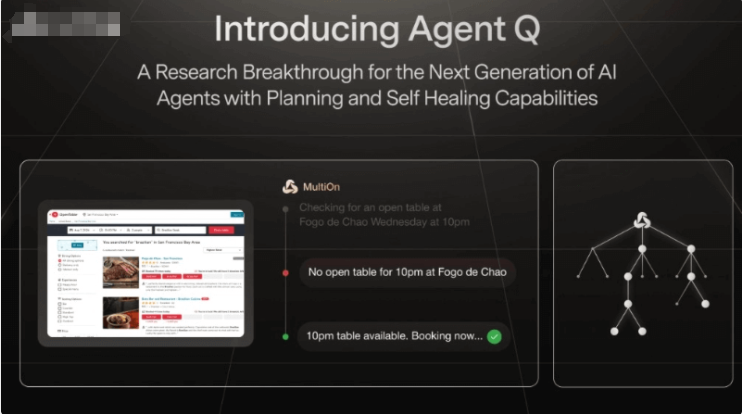

LLM Chat允许用户与LLM进行交互,获取JSON布局提示。

Region Condition部分将JSON条件转换为ComfyUI的区域格式。

支持两种重叠方法:覆盖和平均。

可以与ControlNet/IPAdapter等其他控制方法组合使用。

提供了示例代码,展示如何进行简单的LLM Chat和多轮LLM Chat。

计划实现Omost的区域面积条件(DenseDiffusion)。

计划添加聊天节点的进度条和区域条件编辑器。

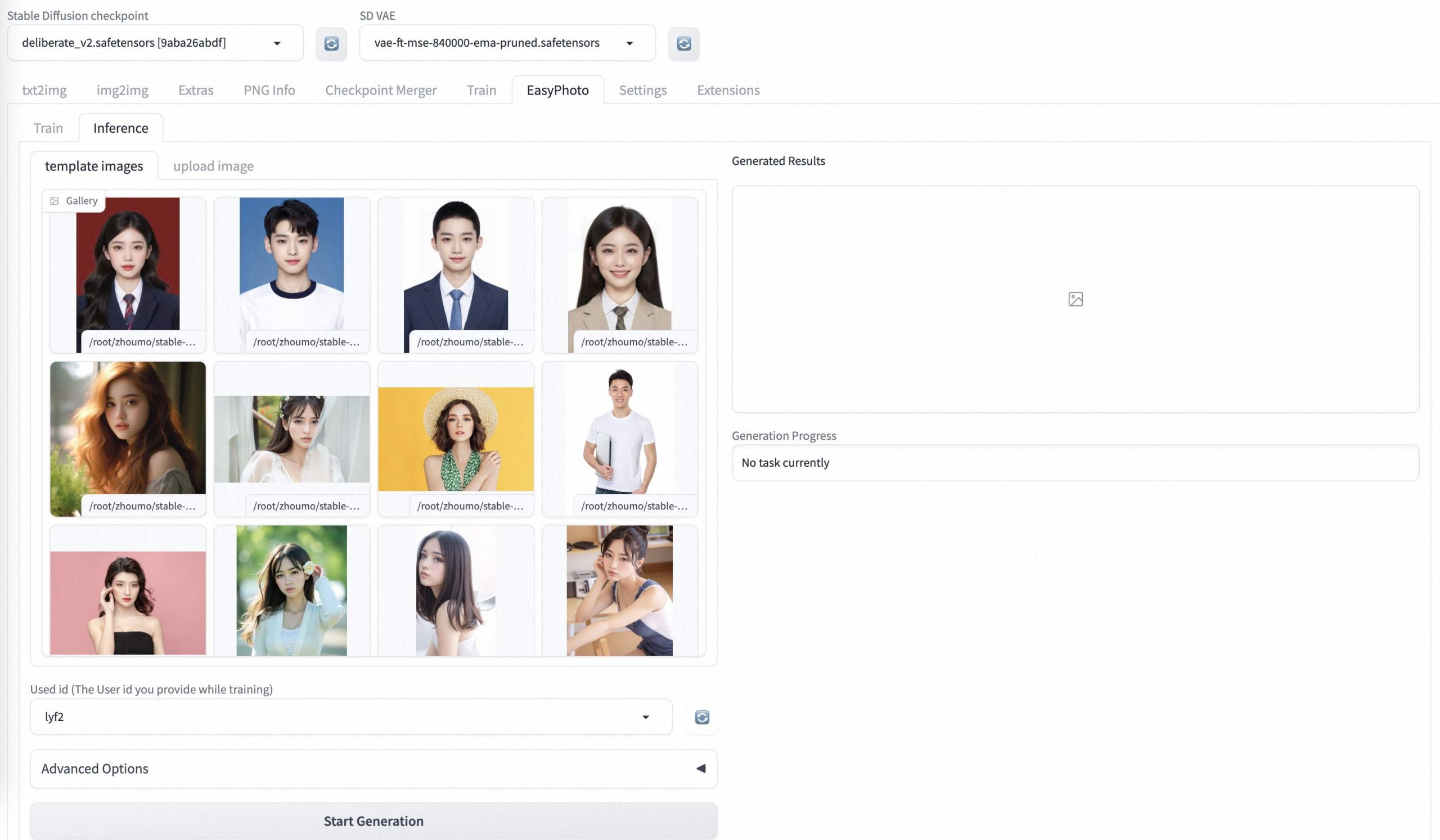

使用教程:

步骤1: 访问ComfyUI_omost的GitHub页面。

步骤2: 阅读README文件,了解模型的基本结构和使用方法。

步骤3: 下载或克隆代码库到本地环境。

步骤4: 根据示例代码设置LLM Chat和Region Condition。

步骤5: 运行代码,与LLM进行交互,获取JSON布局提示。

步骤6: 使用Region Condition将JSON转换为ComfyUI区域格式。

步骤7: 根据需要,将模型与其他控制方法组合使用,生成特定图像。

步骤8: 根据反馈调整参数,优化图像生成结果。