专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

在化学领域,理解分子性质对于加速药物开发和新型材料的发现至关重要。传统方法是依赖于费时费力的人工实验,成本高且效率非常低。这是因为分子的性质和行为极其复杂,需要进行大量的实验来测试和验证。

例如,在药物开发中,研究人员需要合成和测试大量的候选药物分子,以确定它们的活性、毒性和药代动力学性质等。

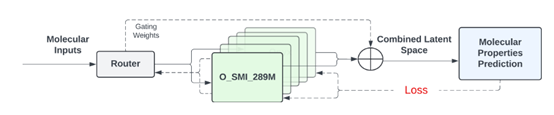

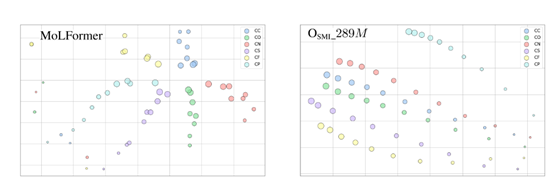

IBM的研究人员推出了专用于化学领域的大模型SMI–TED,一共有2.89亿参数。该模型从全球最大的免费公共化学物质结构数据库PubChem中,精心整理了9100 万个分子的数据集上进行预训练,这些分子相当于 40 亿个分子标记。使SMI–TED能够自动提取分子的特征,并准确预测出它们的性质和行为。

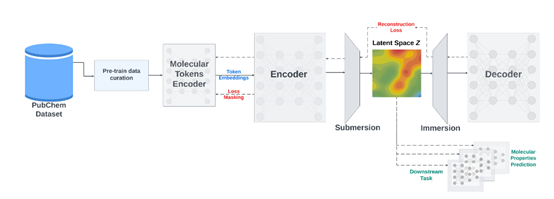

为了帮助模型更好地理解化学的 SMILES 字符串,SMI – TED 的基础模型架构使用了深度双向变压器编码器来细致地处理标记。这种编码器能够有效地捕捉标记之间的复杂关系和上下文信息,从而为模型提供更准确和丰富的标记表示。

同时,该架构还巧妙地结合了编码器 – 解码器架构来生成 SMILES 字符串。在生成过程中,编码器首先对输入的分子信息进行编码,将其转化为潜在的表示形式。然后,解码器利用这些潜在表示来逐步生成 SMILES 字符串,确保生成的字符串准确地反映了分子的结构和性质。

首先,深度双向变压器编码器通过对 SMILES 字符串中的每个标记进行嵌入,将其映射到高维空间中。然后,利用变压器的注意力机制,对这些嵌入进行交互和更新,以学习标记之间的依赖关系。这种深度双向的学习方式使得编码器能够充分考虑标记的前后文信息,从而更好地理解分子的结构特征。

而编码器 – 解码器架构则在生成 SMILES 字符串时发挥了关键作用。解码器根据编码器提供的潜在表示,逐步预测出 SMILES 字符串中的每个字符。在预测过程中,解码器利用先前生成的字符和编码器的信息来指导当前字符的生成,从而保证生成的 SMILES 字符串具有连贯性和准确性。

高质量数据集对于提升SMI – TED的性能至关重要,研究人员从从PubChem 数据库中搜集了1.13 亿条 SMILES 字符串作为初始数据集。然后进行去重和清洗后,得到了9100万个独特且有效的分子结构。

然后,研究人员使用了一个专门设计的分子标记器来构建词汇表,通过对这9100万个分子进行标记化处理,最终生成了包含约40亿个分子标记的词汇表。

在预训练模块方面,SMI – TED模型采用了双阶段预训练策略:在初始阶段,模型使用了大部分的样本对标记编码器进行预训练。这是因为标记编码器的收敛在初始时可能会面临挑战,如果同时对编码器 – 解码器层进行训练,标记编码器的不稳定可能会对整个模型的训练效果产生不利影响。

因此,通过先对标记编码器进行单独的预训练,可以使其更好地学习到分子标记的特征和模式。

当标记编码器达到一定的收敛程度后,模型会使用全部的样本对整个模型进行预训练。此时,编码器 – 解码器层也会参与到训练中,通过学习标记编码器提供的信息,来重建整个 SMILES 字符串。这个阶段的目的是让模型能够学习到分子标记之间的关系,以及如何将这些标记组合成完整的分子结构。

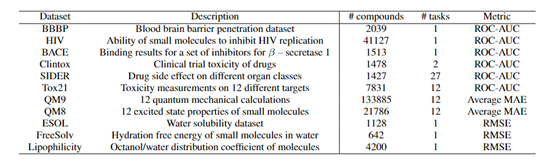

为了测试SMI – TED的性能,研究人员在ChEMBL、Tox21、ToxCast、ZINC、QM9等子数据集进行了综合评测。

结果显示,SMI – TED 在这些子数据集上表现出了优异的性能。例如,在 ChEMBL 数据集中,SMI – TED 能够准确地预测分子的活性和性质,其预测结果与实际值之间的误差较小;在Tox21 和 ToxCast 数据集中,模型对化合物的毒性预测表现出色,为药物安全性评估提供了有力的支持;

在 ZINC 数据集中,SMI – TED 在分子生成任务中展现出了强大的能力,能够生成具有特定性质的新颖分子结构;在 QM9 数据集中,模型对分子的量子力学性质的预测精度较高,为理解和设计新型材料提供了重要的参考。

本文素材来源SMI – TED论文,如有侵权请联系删除

END

来源于网络,如有侵权联系速删

龙跃AI 助手

龙跃AI 助手

暂无评论内容