AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

-

论文链接:https://arxiv.org/pdf/2410.23168

-

开源代码:https://github.com/Haiyang-W/TokenFormer

-

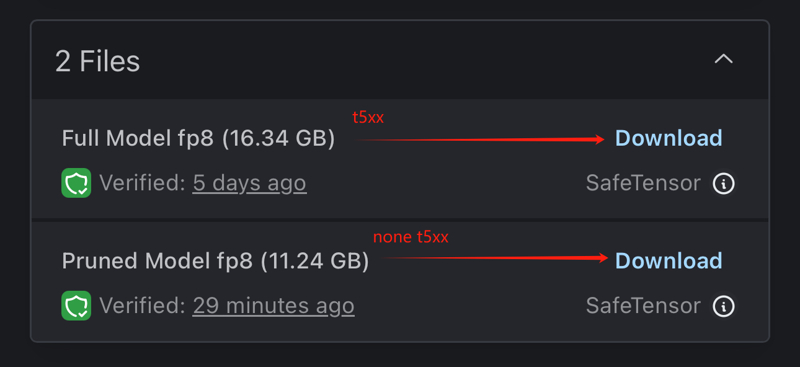

开源模型:https://huggingface.co/Haiyang-W

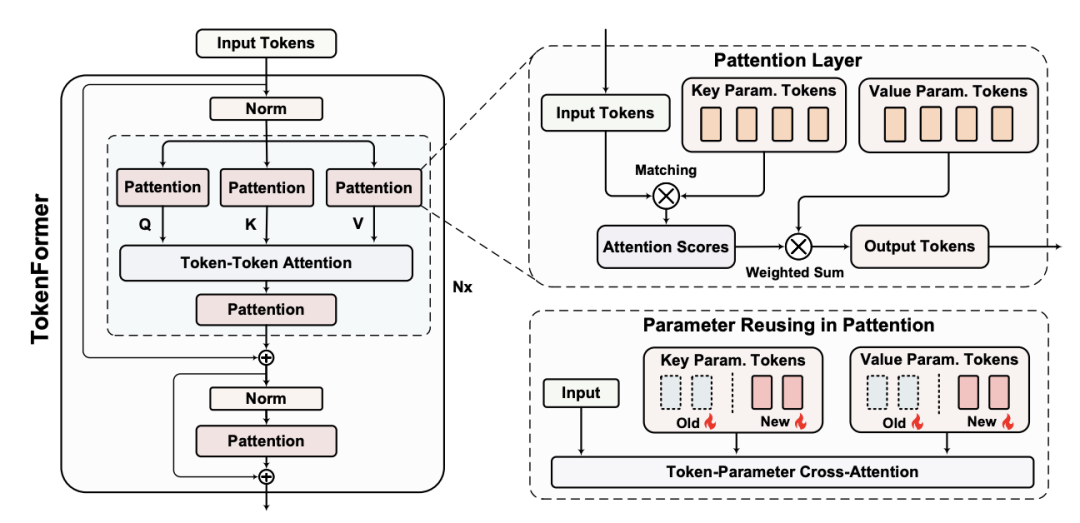

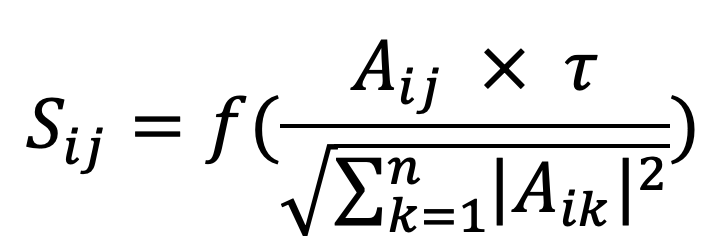

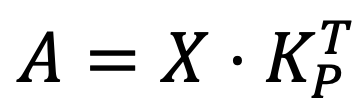

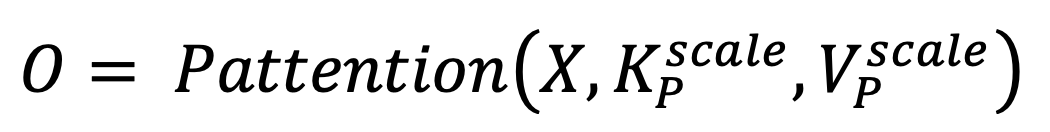

代表 key,

代表 key,  表示 value。输出如下:

表示 value。输出如下:

。

。

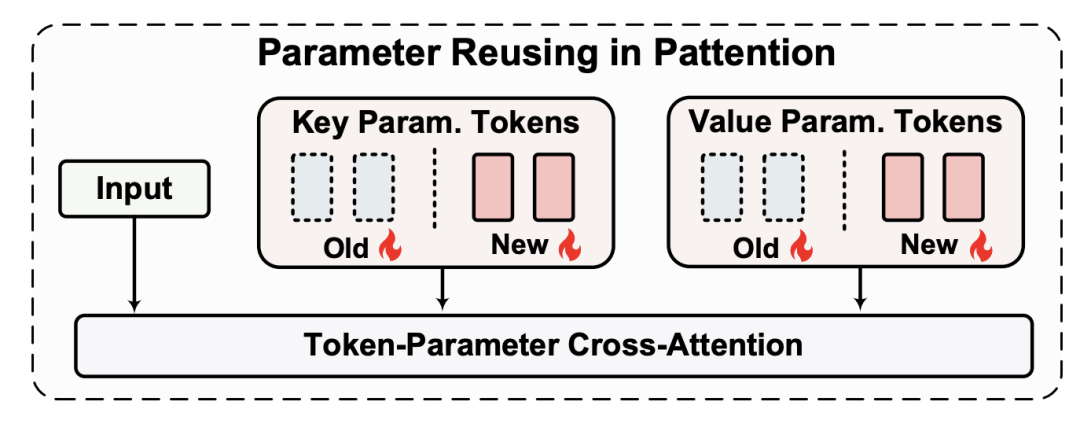

和

和 。

。 和

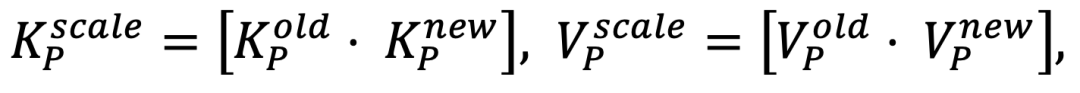

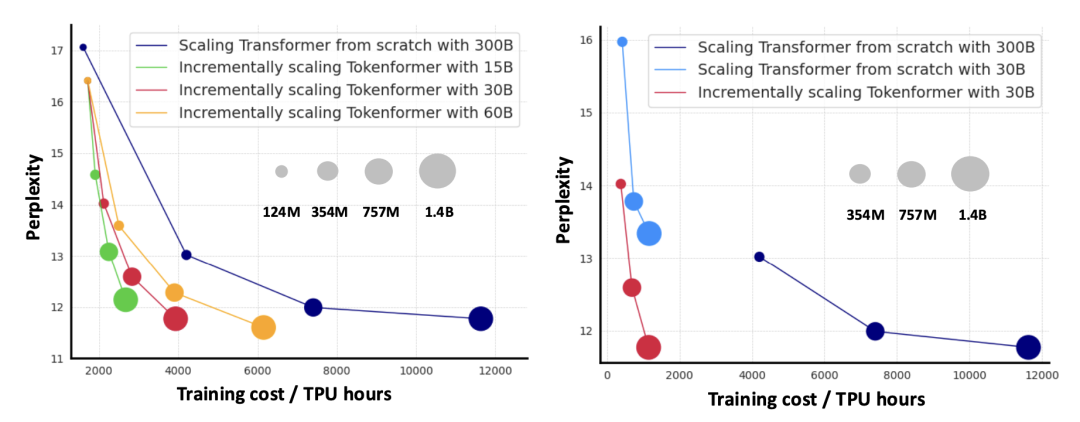

和 ,进而组合成新的 key-value set,

,进而组合成新的 key-value set,

由于 Tokenformer 完全基于注意力机制,它自然受益于在 Token-Parameter 交互中与注意力相关的可解释性特性。这一特点增强了模型的可解释性,为 AI 社区开发更透明、易理解的模型贡献力量。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

龙跃AI 助手

龙跃AI 助手

暂无评论内容