探索ComfyUI中不可或缺的IPAdapter插件,本指南将引导您从基础使用到高级技巧,使您能够充分利用这一强大工具,提升开发效率和应用性能。

1. IPAdapter简介

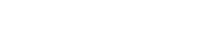

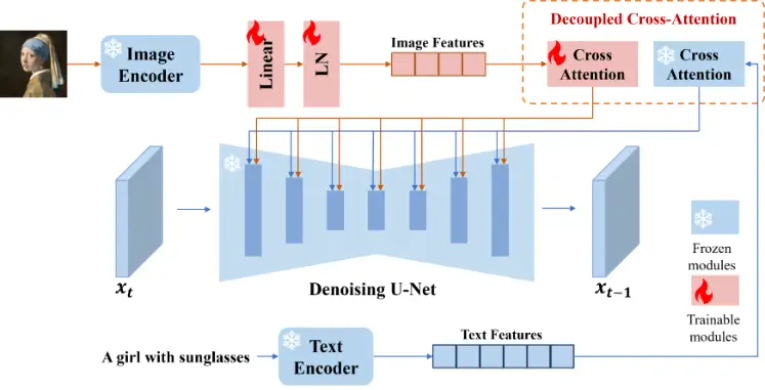

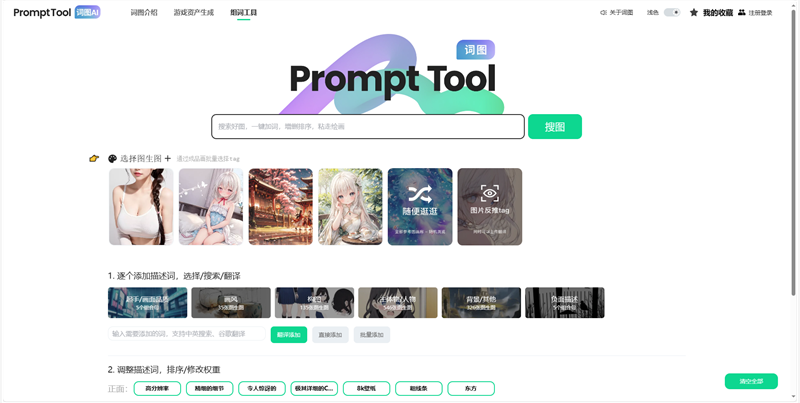

IPAdapter是一个轻量级的适配器,其功能是实现图像风格迁移,即将一张或多张图像的风格转移到另一张图像上。简而言之,它的作用类似于单图像的lora技术。

IPAdapter通过接受一张图像输入,将其编码为Token,并与标准提示词混合,共同作用于图像生成过程。

具体的介绍可以看github上的项目:https://github.com/tencent-ailab/IP-Adapter

2. 安装ComfyUI_IPAdapter_plus插件

首先我们在管理器中安装ComfyUI_IPAdapter_plus,选择作者cubiq的

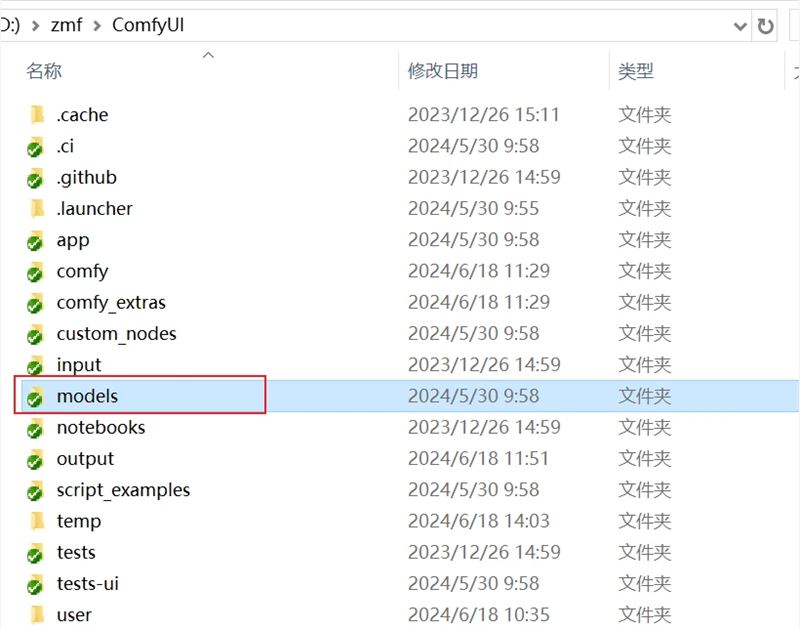

接下来,需要下载相应的模型文件,并将其放置在ComfyUI目录下。

这部分强烈建议看作者的模型安装说明:GitHub – cubiq/ComfyUI_IPAdapter_plus

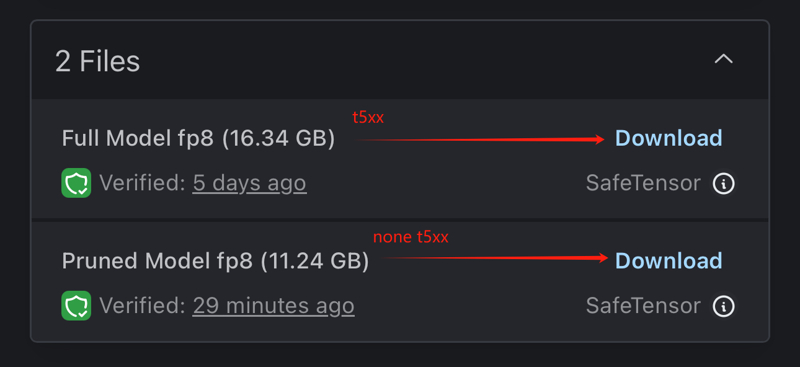

目前支持的模型包括clip_vision视觉模型和IP-Adapter模型,具体包括:

模型不用全部下载,可以按需下载,我这里用到的是SDXL plus v2 和对应的SDXL plus v2 LoRA还有ip-adapter-plus_sd15.safetensors

注意,带有”sd15″后缀的模型适用于sd15 大模型,带有”sdxl”后缀的适用于sdxl大模型。同时,带有”vit-h”的模型使用ViT-H视觉编码器,而带有”vit-G”的则使用ViT-G编码器。

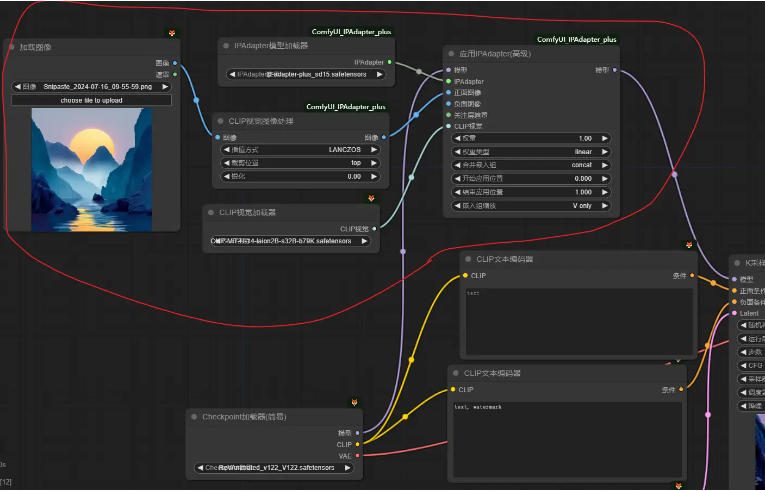

3. 基础工作流

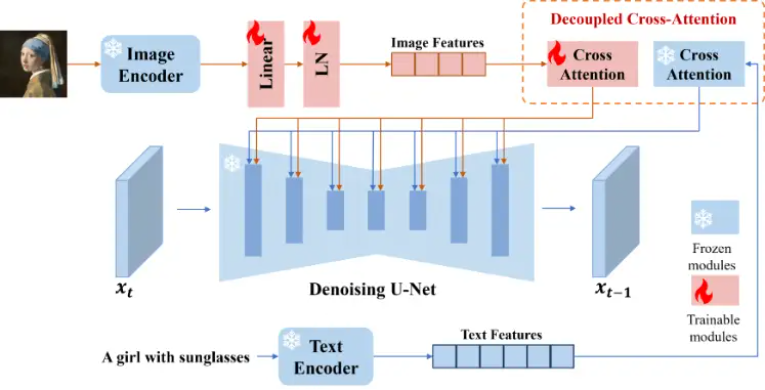

本节介绍如何仅使用IPAdapter引导图像扩散,而不依赖提示词。主要涉及以下几个节点:

- 应用IPAdapter :用于读取并转换图像特征。

- IPadpter Model Loader:加载IPAdapter模型。

- Load CLIP Vision:加载CLIP视觉模型。

基础工作流就是在文生图的基础上添加了这一块

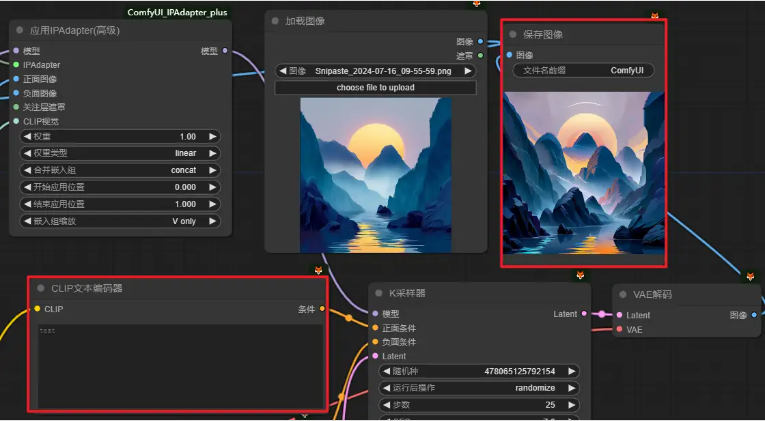

我们可以在不使用任何提示词的情况下生成,类似画风的图像

,

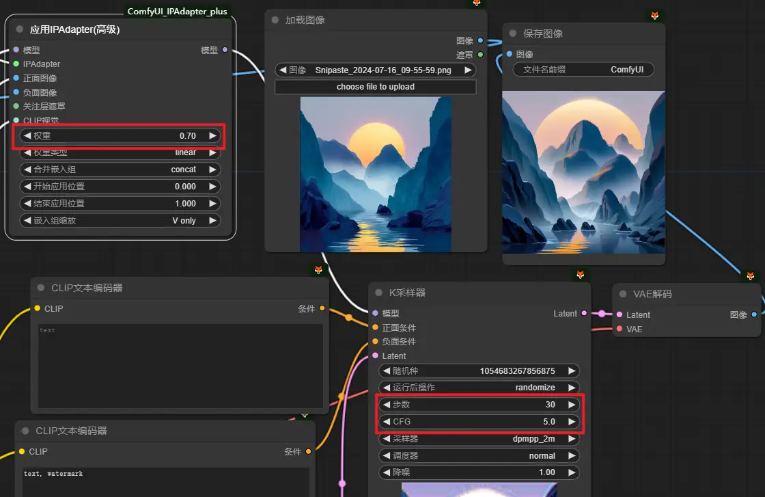

4. 使用IPAdapter生成高质量图像

使用IPAdapter时,可能会遇到图像过拟合的问题。解决这一问题的方法是降低CFG值并提高迭代步数或者降低应用ipadapter的权重。此外,还可以通过image_negative输入图像来消除过拟合并平滑画面。可以对比上图,调整后的图像更会与原图更相似

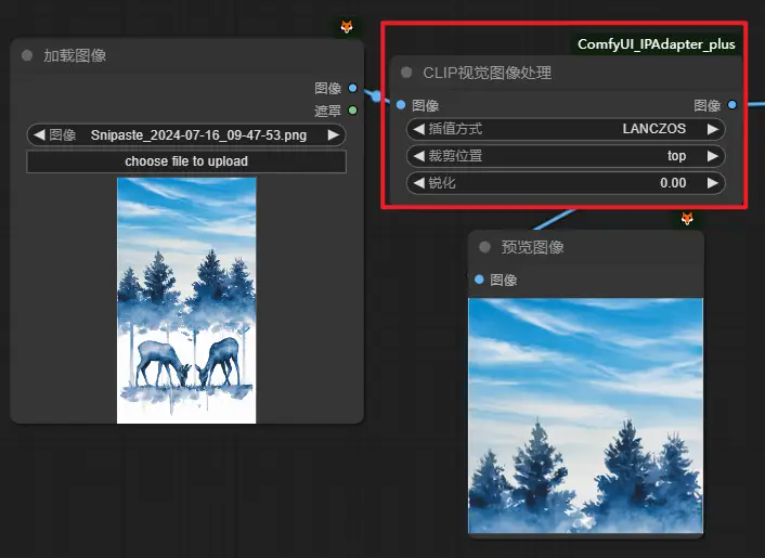

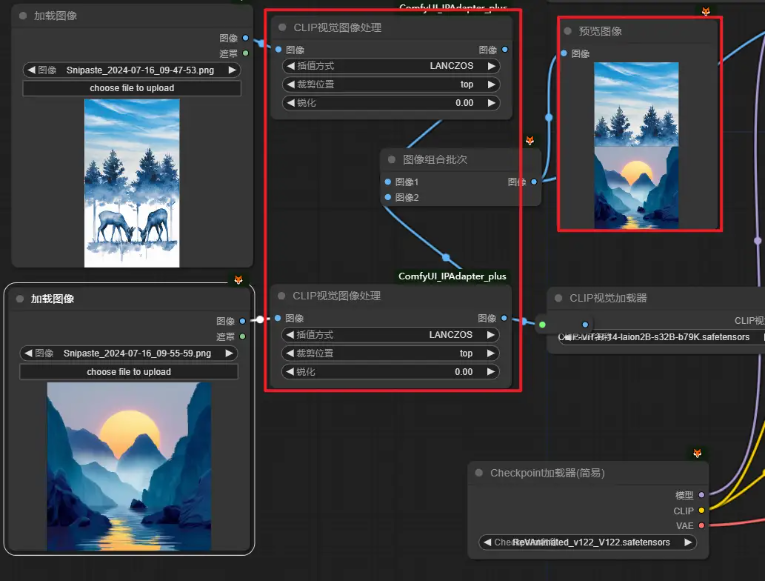

5. 预处理图像

IPAdapter仅支持方形参考图,并默认进行居中裁剪。如果需要参考图像的特定部分,可以使用”Prep Image For ClipVision”节点进行图像处理。例如下图,我那么长的图片经过裁剪后只留下上半部分的正方形图像

6. 多张输入图像参考

IPAdapter能够同时参考多张图片的风格。在使用多张参考图时,应考虑希望在结果图像中添加哪些元素。我们可以使用图像组合批次进行多张图片的参考

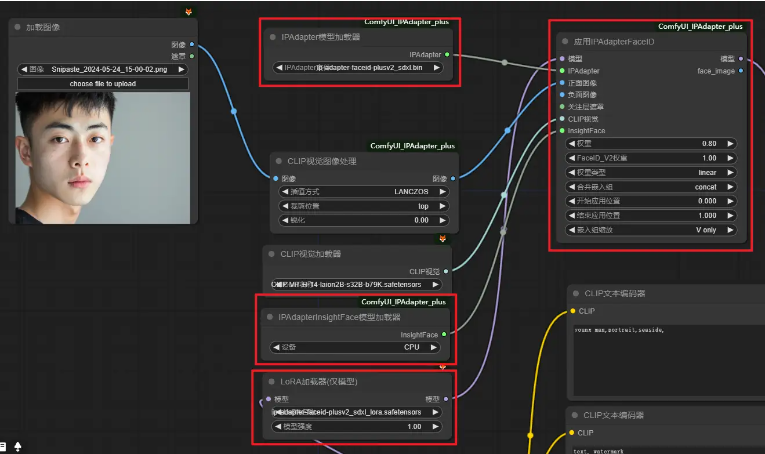

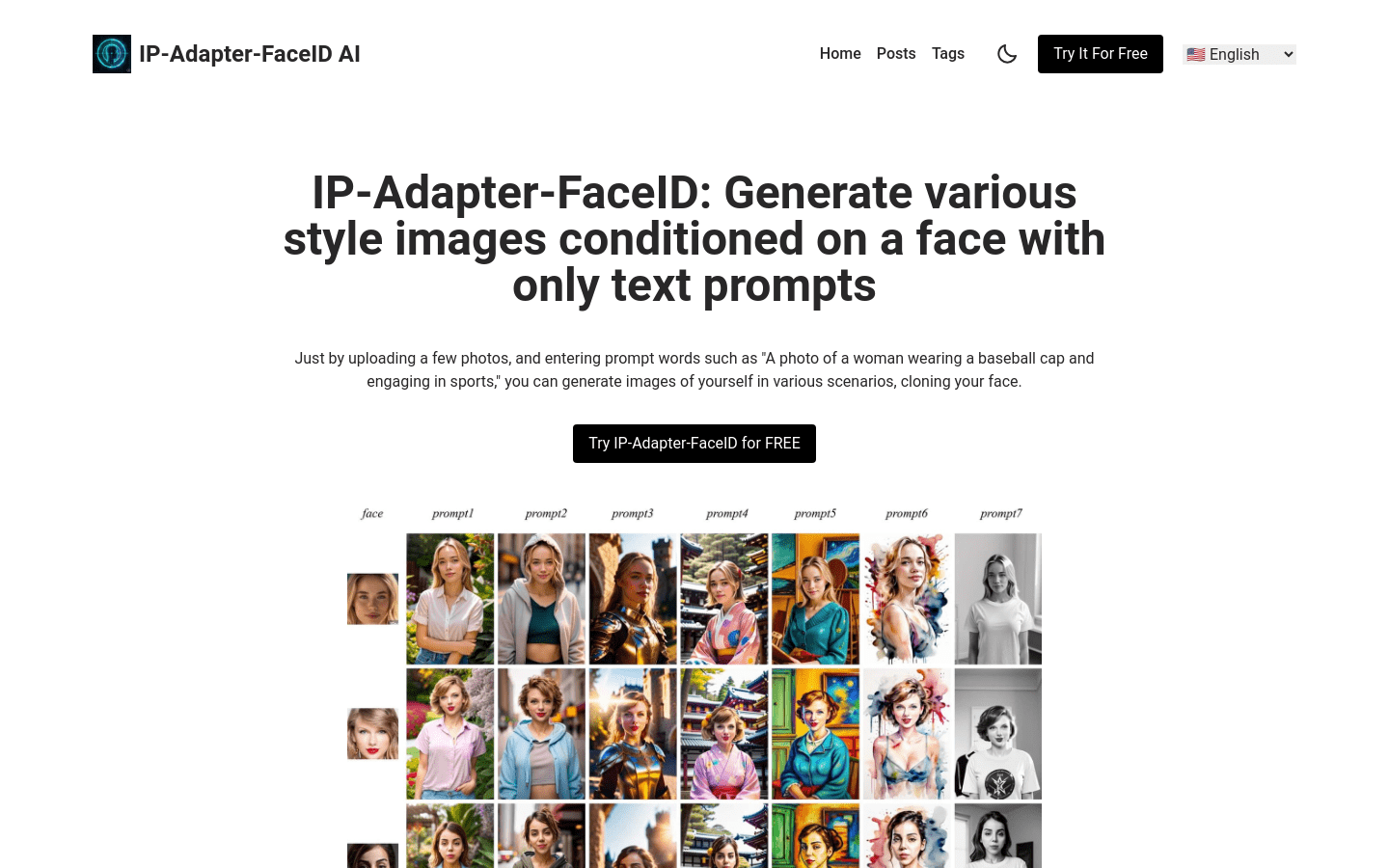

7. ip-adapter-faceid-plusv2_sdxl模型

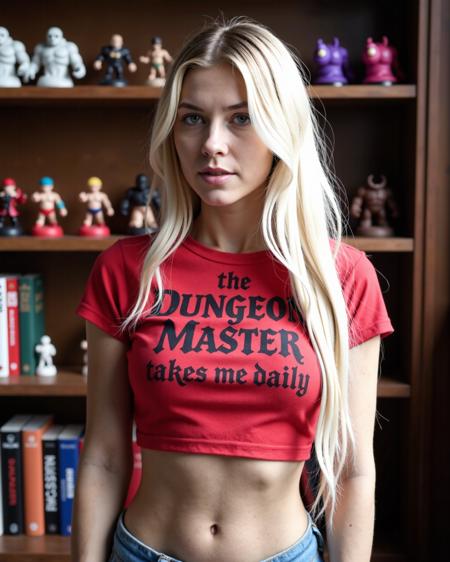

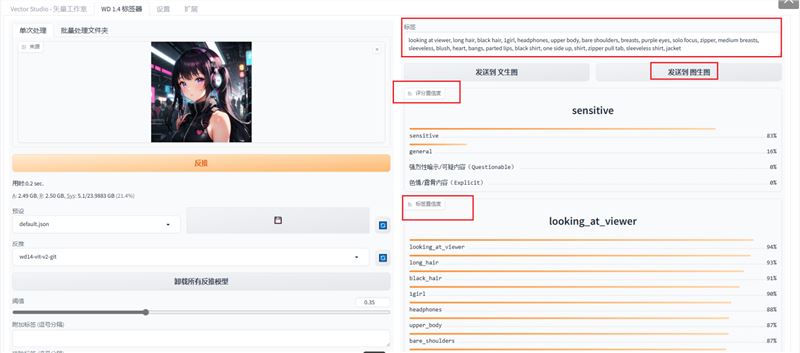

该模型专门用于参考人脸,会尽可能描述脸部特征,如眉毛形状、头发颜色等,以生成相似的脸部。经过我的测试 ip-adapter-faceid-plusv2_sdxl会比sd15 的模型好上不少。使用上也非常简单。我们把应用ipadapter改成应用ipadapterfaceid。然后模型修改成 ip-adapter-faceid-plusv2_sdxl,由于改模型必须搭配lora所以我们还需要加载对应的lora模型,最后再添加ipadapterinsightface的模型加载器

对比生成效果还是有七分相似的

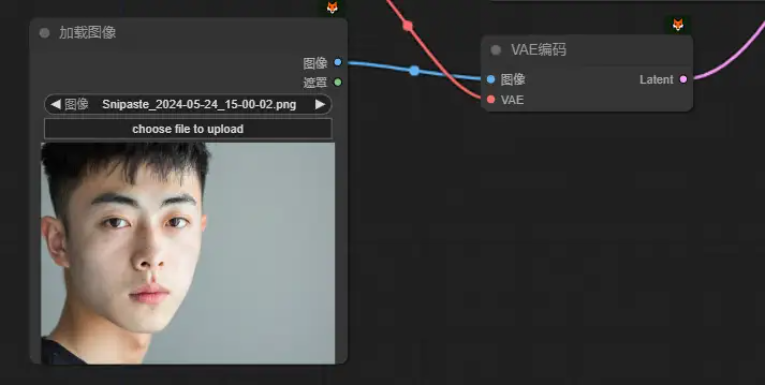

8. IPAdapter在图生图中的应用

输入一张人像像作为底图,使用IPAdapter生成图像。

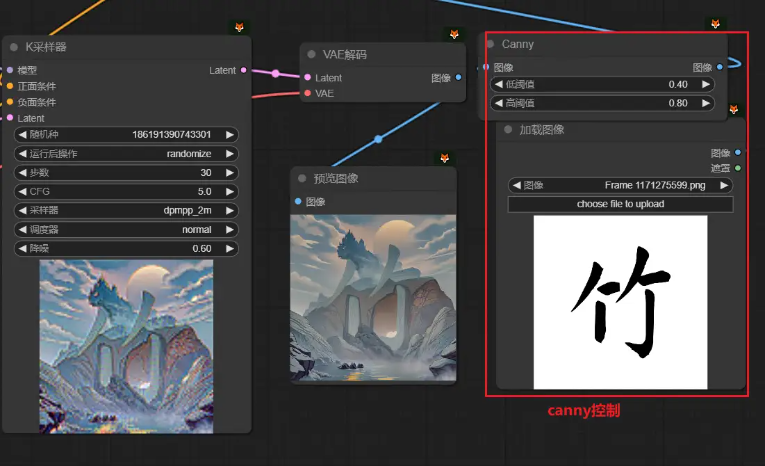

9. ControlNet

在控制图像构图的同时,增加IPAdapter的参考,以生成保留构图并参考风格的作品。

10. Embedding嵌入组

为了节省显存,可以将CLIP视觉模型处理后的数据保存为Embedding,后续直接使用。

我们使用IPadapter编码在右边拉出保存嵌入组即可保存为Embedding

保存的路径为output文件夹内

使用时我们添加 IPAdaper Load Embeds(读取嵌入组)节点加载Embeddings即可

以上就是IPAdapter的基础使用方法,如果有收获的话请点赞支持一下哦。有任何问题请加入我们的学习交流群哦

龙跃AI 助手

龙跃AI 助手