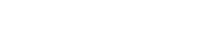

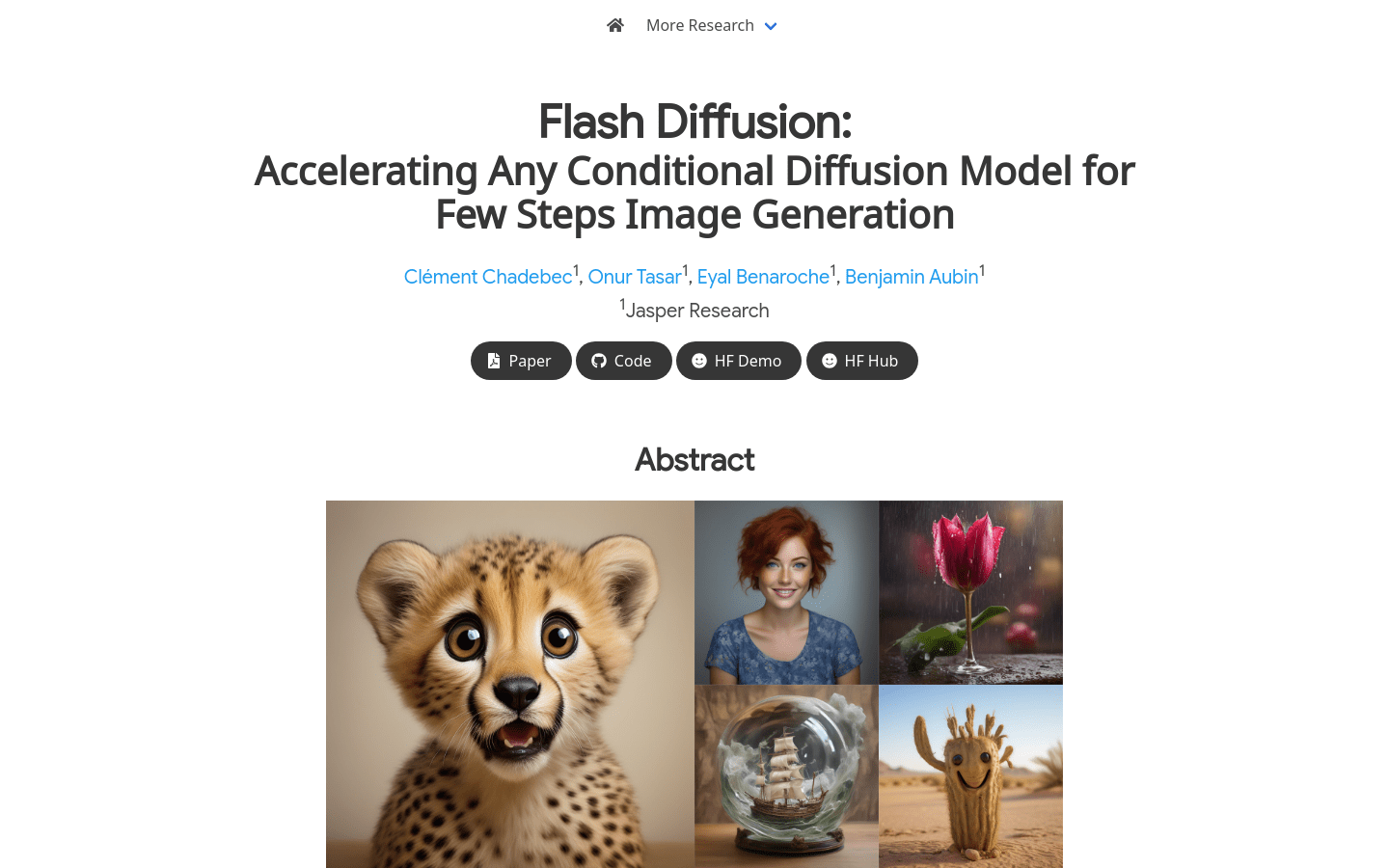

Flash Diffusion

Flash Diffusion 是一种高效的图像生成模型,通过少步骤生成高质量的图像,适用于多种图像处理任务,如文本到图像、修复、超分辨率等。该模型在 COCO2014 和 COCO2017 数据集上达到了最先进的性能,同时训练时间少,参数数量少。

需求人群:

“目标受众为需要快速生成高质量图像的研究人员和开发者,特别是在图像生成、编辑和增强领域。”

使用场景示例:

使用Flash Diffusion进行文本到图像的转换,将描述性文本快速转化为视觉图像。

在艺术创作中,利用Flash Diffusion进行图像修复,填补缺失部分。

在媒体制作中,使用Flash Diffusion进行人脸交换,创造新的视觉效果。

产品特色:

少步骤图像生成,减少计算资源消耗

适用于多种图像处理任务,如文本到图像、修复等

使用不同的后端模型,如基于UNet的去噪器和DiT模型

通过对抗性目标和分布匹配失真损失提高样本质量

训练过程中采样时间步从可适应的分布中抽取,帮助学生模型针对特定时间步

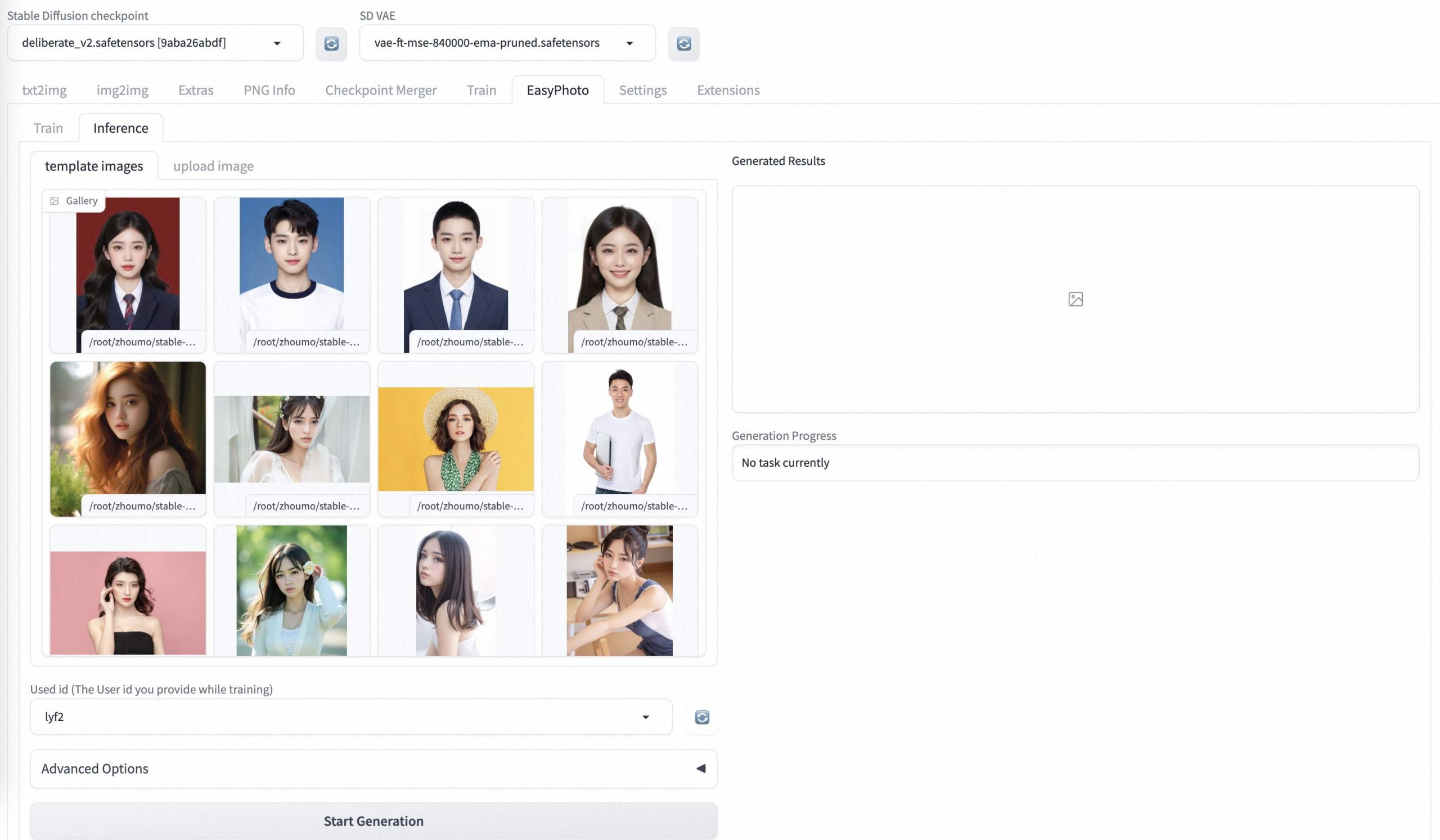

使用教程:

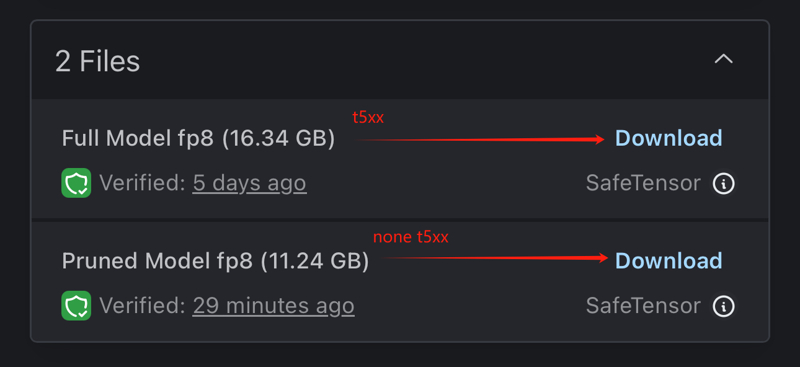

1. 访问Flash Diffusion的官方GitHub页面,了解模型的基本信息和使用条件。

2. 下载并安装所需的依赖库和工具,确保环境配置正确。

3. 根据具体的图像生成任务,准备相应的输入数据,如文本描述、损坏的图像等。

4. 运行Flash Diffusion模型,输入数据并指定生成参数。

5. 等待模型生成结果,根据需要进行后处理。

6. 分析生成的图像质量,根据反馈调整参数以优化结果。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

龙跃AI 助手

龙跃AI 助手